Le réseau social a mis en place un outil permettant de repérer des personnes ayant des envies suicidaires. Il identifie régulièrement les comptes Facebook. Il n’est pas encore appliqué en Europe

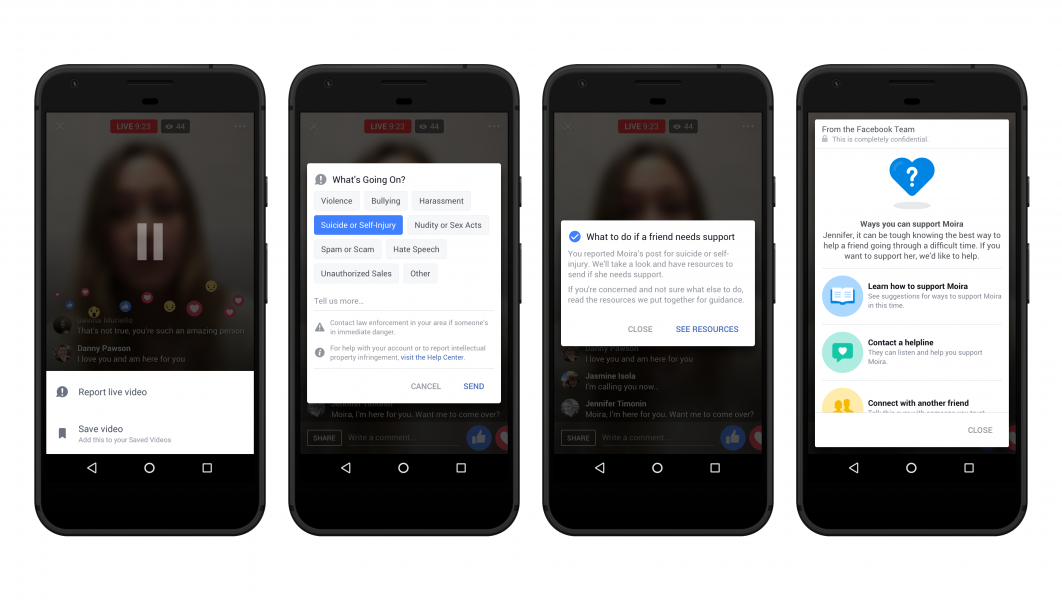

Après plusieurs tests et expertises, Facebook annonce mettre en place un outil capable de détecter des comportements suicidaires de ses utilisateurs à travers leurs activités sur leurs profils. Le but étant de dissuader les personnes voulant mettre fin à leurs jours. Cela passera par le Facebook Live, mais également par une assistance via Messenger. L’intelligence artificielle jouera aussi un rôle dans le combat: elle est entraînée à identifier à reconnaître des mots et/ou des phrases, ou à identifier les images postées par la personne identifiée.

Après plusieurs tests et expertises, Facebook annonce mettre en place un outil capable de détecter des comportements suicidaires de ses utilisateurs à travers leurs activités sur leurs profils. Le but étant de dissuader les personnes voulant mettre fin à leurs jours. Cela passera par le Facebook Live, mais également par une assistance via Messenger. L’intelligence artificielle jouera aussi un rôle dans le combat: elle est entraînée à identifier à reconnaître des mots et/ou des phrases, ou à identifier les images postées par la personne identifiée.

Si l’initiative est louable, elle reste cependant inapplicable sur le territoire de l’union européenne. Pour cause, la General Data Protection Regulation, qui sera appliquée le 25 mai 2018, interdit ce genre de pratique.

Facebook : l’autre côté de l’IA

Dans les pays où le GDPR n’est pas en vigueur, il est impossible de désactiver le scan automatique luttant contre le suicide. Du coup, l’intelligence artificielle fera une intrusion quasi quotidienne dans la vie privée des utilisateurs.

Aussi, une utilisation de cet outil à but commercial ou de limitation de l’expression n’est pas impossible. Le risque zéro n’existe pas, c’est ce que dit Alex Stamos sur Twitter :

The creepy/scary/malicious use of AI will be a risk forever, which is why it's important to set good norms today around weighing data use versus utility and be thoughtful about bias creeping in. Also, Guy Rosen and team are amazing, great opportunity for ML engs to have impact. https://t.co/N9trF5X9iM

— Alex Stamos (@alexstamos) November 27, 2017

Et vous, qu’en pensez-vous ? Dites-le nous dans les commentaires, votre avis nous intéresse.